有圖未必是真相 AI技術如何編造謠言及網絡信息安全軟件的應對之道

在信息爆炸的今天,圖像和視頻已成為網絡傳播的主流形式。隨著人工智能(AI)技術的飛速發展,有圖未必是真相——AI工具能夠輕易生成、修改圖像和視頻,甚至編造出看似真實的謠言,對個人隱私、社會穩定構成威脅。本文將探討AI技術如何被濫用于編造虛假信息,并介紹網絡與信息安全軟件如何應對這一挑戰。

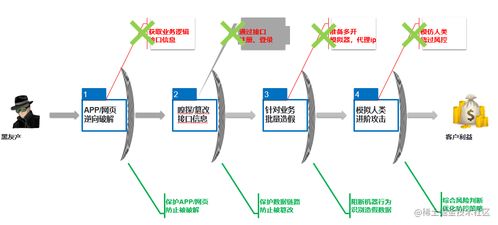

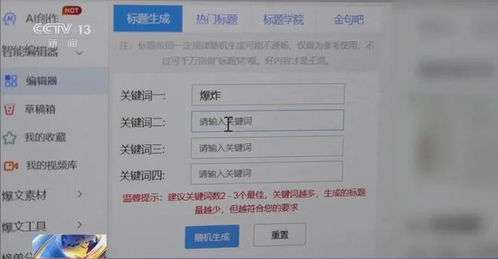

AI技術如何助力謠言制造?以深度偽造(Deepfake)為例,這項技術利用生成對抗網絡(GAN)等算法,可將一個人的面部表情、聲音無縫替換到另一段視頻中,制造出名人發表不當言論或普通人參與虛假事件的影像。AI圖像生成工具(如DALL·E或Stable Diffusion)能憑空創造出逼真的圖片,例如虛假災難現場或政治事件,再配以誤導性文字,迅速在社交媒體擴散。這些技術降低了造謠門檻,使得普通用戶也能快速生產“證據”,加劇了信息混亂。

AI編造的謠言危害深遠。一方面,它可能侵犯個人權益,如利用偽造圖像進行誹謗或詐騙;另一方面,它可能擾亂公共秩序,例如在選舉期間散布虛假信息,影響輿論導向。根據研究,AI生成的虛假內容傳播速度是真實信息的6倍,且難以被普通用戶識別,這凸顯了網絡信息安全的緊迫性。

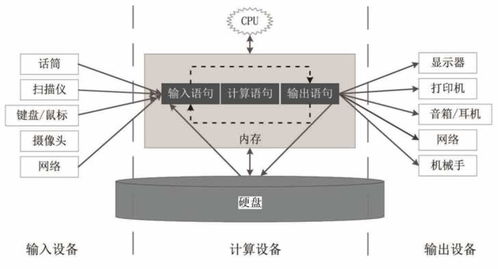

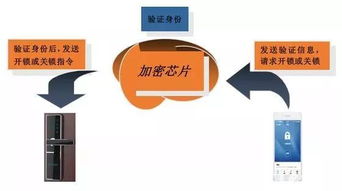

面對這一挑戰,網絡與信息安全軟件的開發顯得至關重要。當前,業界已推出多種工具來檢測和防范AI生成的虛假內容。例如,基于AI的反偽造軟件使用機器學習模型分析圖像和視頻的元數據、像素級特征,識別出深度偽造的痕跡;區塊鏈技術則被用于驗證媒體來源,確保信息的真實性。安全軟件還集成實時監控和警報功能,幫助用戶過濾可疑內容,并提供教育性提示,提升公眾的數字素養。

隨著AI技術的演進,網絡與信息安全軟件需不斷創新。開發者應加強跨領域合作,整合計算機視覺、自然語言處理等技術,提高檢測準確率;推動立法和行業標準,確保AI應用的倫理邊界。普通用戶也應保持警惕,不輕信未經核實的信息,并積極使用安全工具保護自己。

AI技術是一把雙刃劍,它在推動社會進步的也為謠言制造提供了新工具。通過加強網絡與信息安全軟件的研發和應用,我們可以更有效地揭開虛假真相,維護清朗的網絡空間。記住:在數字時代,批判性思維和安全軟件是我們的第一道防線。

如若轉載,請注明出處:http://m.2r78mg.cn/product/28.html

更新時間:2026-01-08 14:41:48